目次

AIプラットフォームとは?基本を理解する

「AIプラットフォーム」という言葉を耳にする機会が増えてきました。DXやデジタル化が叫ばれる中、「うちの会社も何かしなければ」と感じている経営者の方も多いのではないでしょうか。

AIプラットフォームとは、一言で表すならAI開発や運用に必要な機能がまとまった基盤のことです。料理に例えるなら、食材から調理器具、レシピまで揃ったキッチンのようなもの。専門的な知識がなくても、AIを活用した業務改善やデータ分析ができる環境が整っています。

従来のシステム開発との違い

従来の業務システム開発では、要件定義から設計、開発、テストまで、すべてを一から作り上げる必要がありました。開発期間は数ヶ月から1年以上、費用も数百万円から数千万円かかることも珍しくありません。

一方、AIプラットフォームを活用すると、既に用意された機能を組み合わせて利用できます。顧客データの分析や需要予測といった機能を、短期間で実装可能です。

| 比較項目 | 従来のシステム開発 | AIプラットフォーム |

|---|---|---|

| 開発期間 | 数ヶ月〜1年以上 | 数週間〜数ヶ月 |

| 初期費用 | 数百万円〜 | 月額数万円〜 |

| 専門知識 | 高度なスキル必須 | 最小限でも可能 |

| 柔軟性 | 修正に時間とコスト | 比較的容易に変更可能 |

この違いは、限られた予算と人材で、スピーディーにデジタル化を進める必要がある中小企業にとって特に重要です。

なぜ今注目されているのか

AIプラットフォームへの注目が高まっている背景には、いくつかの要因があります。

DX推進の必要性が明確になったことが第一です。コロナ禍を経て、デジタル化の遅れが競争力の低下に直結することが浮き彫りになりました。しかし、多くの中小企業では「何から始めればいいかわからない」「IT人材がいない」という課題を抱えています。

AI技術の民主化も大きな要因です。かつてAI開発は一部の専門家だけのものでしたが、技術の進歩により、誰でも使えるツールとして提供されるようになりました。特に2023年以降、生成AIの普及により「AIは特別なものではない」という認識が広がっています。

さらに、コストと時間の削減が実現したことで、「試してみる」ハードルが下がっています。従来は数百万円かかっていたAI開発が、月額数万円から利用できるようになり、大企業だけでなく中小企業でもAI活用が現実的になりました。

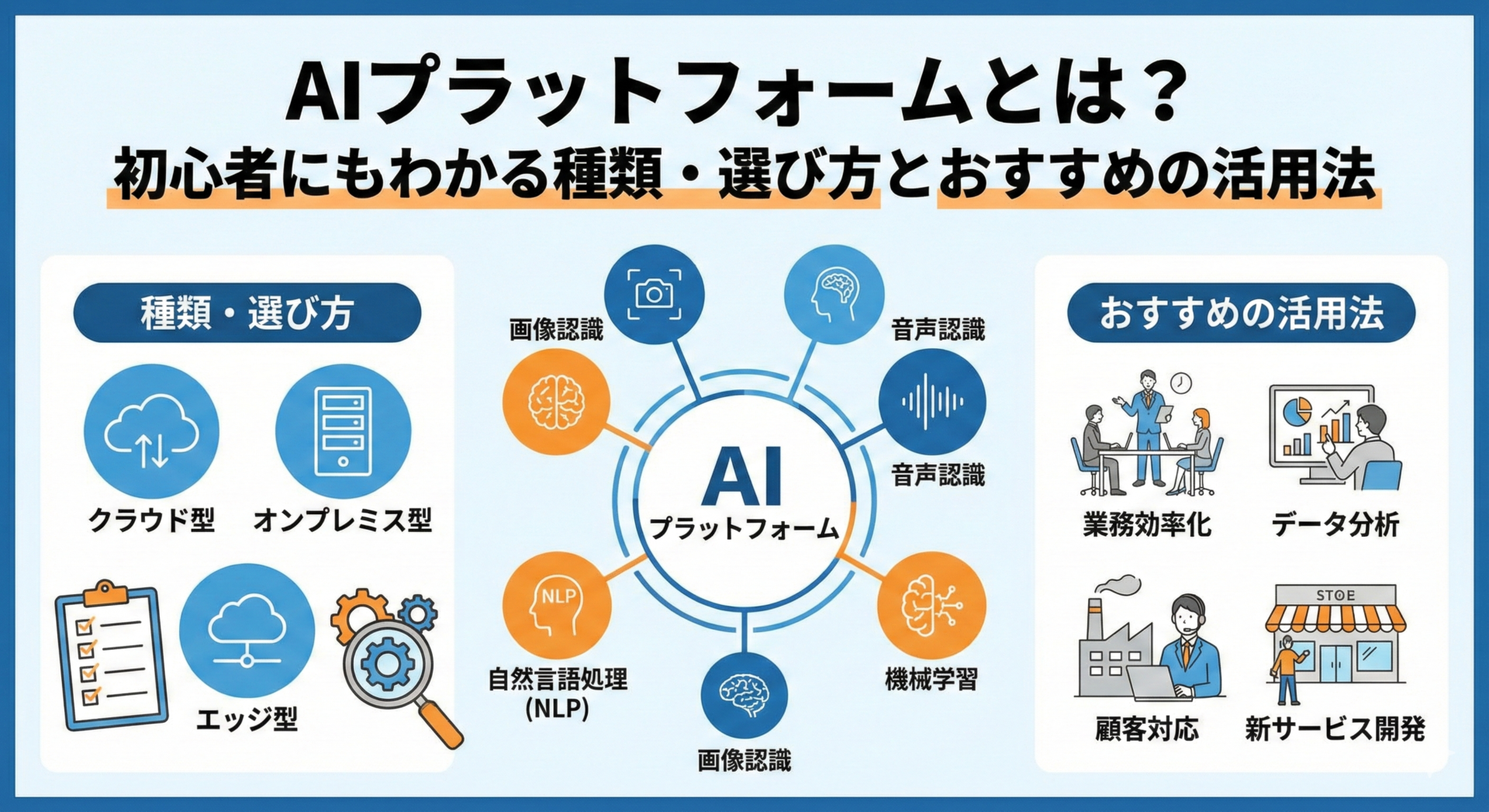

AIプラットフォームの種類と選び方

AIプラットフォームは大きく分けて3つのタイプがあります。自社に合ったものを選ぶには、それぞれの特徴を理解することが重要です。

クラウド型AIプラットフォーム

AWS、Google Cloud、Microsoft Azureなど、大手テクノロジー企業が提供する総合的なAI開発環境です。

特徴

- 機械学習、画像認識、自然言語処理など幅広いAI機能を提供

- 初期投資が不要で、使った分だけ課金される従量課金制

- 高い可用性とセキュリティ

向いている企業

- ある程度の技術リソースがある企業

- 将来的に大規模なデータ処理を見込んでいる企業

注意点

- 機能が豊富な分、何をどう使えばいいか分かりにくい

- 技術的な知識がないと、コストが予想以上に膨らむ可能性がある

業務特化型AIプラットフォーム

営業支援、顧客対応、在庫管理など、特定の業務に特化したAIプラットフォームです。

特徴

- 業務に必要な機能があらかじめ組み込まれている

- 導入から運用までのサポートが手厚い

- 専門知識がなくても使い始められる

向いている企業

- 解決したい課題が明確な企業

- IT人材が限られている中小企業

- 早く成果を出したい企業

注意点

- カスタマイズの自由度が限られる

- 複数の業務に横断的に使うのは難しい場合がある

オープンソース型とエンタープライズ型

オープンソース型(TensorFlow、PyTorchなど)は無料で利用できますが、技術的な知識が必須で、サポートは基本的に自己責任です。

エンタープライズ型は有償ですが、導入から運用まで手厚いサポートがあり、セキュリティやコンプライアンスへの対応も整っています。

中小企業の場合、技術リソースが限られているため、エンタープライズ型または業務特化型を選ぶのが現実的です。

選択のポイント

| タイプ | 初期コスト | 運用負担 | サポート | おすすめ度(中小企業) |

|---|---|---|---|---|

| クラウド型 | 低 | 中〜高 | 中 | ★★☆☆☆ |

| 業務特化型 | 低〜中 | 低 | 高 | ★★★★★ |

| オープンソース型 | 無料 | 高 | 低 | ★☆☆☆☆ |

| エンタープライズ型 | 中〜高 | 低〜中 | 高 | ★★★★☆ |

重要なのは、「全部入り」の高機能なものを選ぶことではなく、自社の課題に対して「ちょうどいい」ものを選ぶことです。

AIプラットフォームでできること

AIプラットフォームを導入すると、具体的にどのようなことができるのでしょうか。ビジネスにどう役立つかという視点で見ていきましょう。

データの収集・整理・管理

AIを活用する上で最も重要なのが、データの準備です。AIプラットフォームは、この面倒な作業を効率化してくれます。

できること

- 複数のExcelファイルや業務システムからデータを自動収集

- バラバラな形式のデータを統一した形式に整理

- 欠損データや異常値を自動検出・修正

従来、営業担当者ごとに異なるExcelファイルで顧客情報を管理していた企業が、AIプラットフォームでデータを一元化することで、顧客の重複や漏れがなくなり、営業活動の全体像が把握できるようになります。

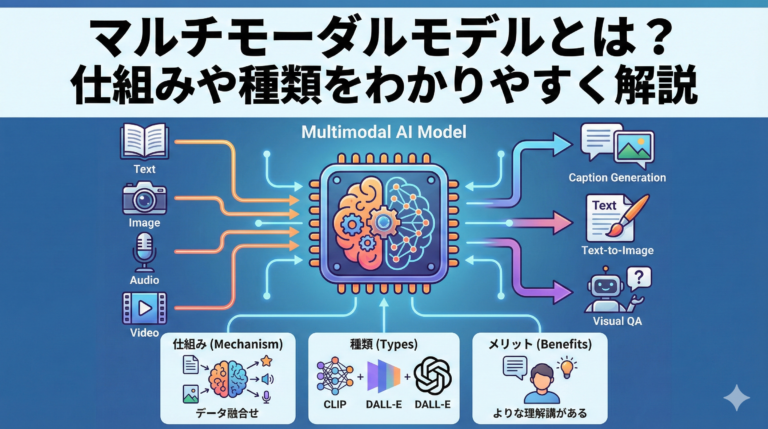

機械学習モデルの開発

「機械学習」と聞くと難しそうに感じますが、AIプラットフォームを使えば、専門知識がなくても実用的なモデルを作成できます。

できること

- 売上予測、需要予測、顧客行動の予測

- 画像からの不良品検出や文字認識

- 顧客からの問い合わせ内容の自動分類

開発の流れ

- 過去の実績データをアップロード

- 目的に応じたテンプレートを選択

- プラットフォームが自動的に学習を実施

- 予測結果の正確性をチェック

- 必要に応じてパラメータを調整

この一連のプロセスを、GUIベースの操作で完結できるのが、現代のAIプラットフォームの強みです。

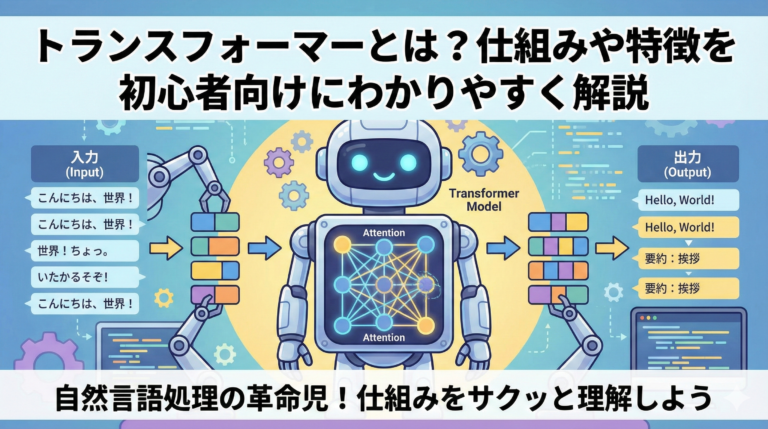

AIモデルの運用とMLOps

せっかく作ったAIモデルも、実際の業務で使えなければ意味がありません。ここで重要になるのがMLOps(Machine Learning Operations)です。

AIモデルは一度作って終わりではありません。ビジネス環境の変化や新しいデータの蓄積により、予測精度が低下していきます。MLOps機能を備えたAIプラットフォームを使えば、以下のことが自動化されます。

- モデルの予測精度の監視

- 精度が低下した際のアラート通知

- 新しいデータでの自動再学習

- モデルのバージョン管理と切り戻し

従来、AIモデルの運用には専門のデータサイエンティストが必要でした。しかし、MLOps機能があれば、専門家がいなくても安定的にAIを運用できます。

分析結果の可視化とビジネス活用

AIの分析結果をどう活用するかが、最終的な成果を左右します。

できること

- 予測結果をダッシュボードでリアルタイム表示

- グラフやチャートで傾向を視覚的に把握

- レポートの自動生成と定期配信

- 異常値や注意すべき変化の自動検知とアラート

従来のExcel管理では、データの集計や分析に時間がかかり、レポート作成も手作業でした。AIプラットフォームなら、これらが自動化され、常に最新の状態が把握できます。

「月末に集計して翌月の会議で報告」ではなく、「今日の状況を今日のうちに確認して即座に対応」という経営スタイルが可能になります。

中小企業がAIプラットフォームを選ぶ際の重要ポイント

実際に選ぶ際には何を基準にすればよいのでしょうか。中小企業ならではの視点で、選定のポイントを整理します。

自社の課題と目的を明確にする

AIプラットフォーム選びで最も重要なのは、「何のために導入するのか」を明確にすることです。

よくある失敗パターン

- 「とりあえずAIを導入しよう」と目的が曖昧なまま始める

- 機能の多さに惹かれて、使いこなせない高機能なものを選ぶ

- 現場の声を聞かずに、経営層だけで決めてしまう

課題の明確化ステップ

- 業務で時間がかかっている作業、ミスや漏れが発生しやすい箇所を洗い出す

- 解決した場合のインパクトが大きいものから優先順位をつける

- 目標を数値化する(例:「業務時間を週10時間削減」「在庫回転率を20%改善」)

具体的な目標があれば、導入後の効果測定もしやすくなります。

必要な機能と不要な機能を見極める

多くの中小企業にとって、最初から全機能を使いこなす必要はありません。まずは「今すぐ必要な機能」に絞って導入し、慣れてきたら段階的に活用範囲を広げるのが現実的です。

チェックリスト例

- 既存の業務システムと連携できるか

- 日本語のサポートは充実しているか

- スマートフォンからも利用できるか

- 無料トライアル期間はあるか

導入コストと運用負担のバランス

AIプラットフォーム選びでは、初期費用だけでなく、継続的にかかるコストと運用の負担を総合的に判断する必要があります。

費用対効果の考え方

月額5万円のAIプラットフォームを導入して、週10時間の業務時間が削減できれば、時給換算で十分に元が取れる計算になります。

例:時給3,000円の社員の週10時間削減

- 月間削減時間:40時間

- 削減コスト:120,000円

- プラットフォーム費用:50,000円

- 実質効果:+70,000円/月

ただし、これは「実際に定着して使われた場合」の話です。導入したけど使われなくなった、というのが最も多い失敗パターンです。

運用負担を減らすポイント

- 直感的に使えるUI/UXのものを選ぶ

- 導入時のサポートが手厚いベンダーを選ぶ

- 社内に「推進担当者」を明確に決める

- 小さく始めて、成功体験を積み重ねる

サポート体制の確認

中小企業にとって、ベンダーのサポート体制は非常に重要です。

確認すべきサポート内容

- 初期設定の代行サービスはあるか

- オンボーディング研修は提供されるか

- 日本語でのサポートは受けられるか

- 問い合わせ方法(電話、メール、チャット)と対応時間

AIプラットフォーム導入のメリットと注意点

AIプラットフォームの導入は、中小企業にとって大きな変革のチャンスです。しかし、「導入すれば何でも解決する」という過度な期待は禁物です。

業務効率化と属人化の解消

中小企業が抱える最も深刻な課題の一つが「属人化」です。特定の社員しか分からない業務、その人がいないと回らない仕組み——こうした状況は、企業の成長を妨げる大きな要因になります。

AIプラットフォームが解決できる属人化の問題

- ベテラン社員の判断基準をデータ化し、新人でも一定レベルの判断が可能に

- 作業手順をシステム上で統一し、誰がやっても同じ品質を維持

- Excel管理から脱却し、情報を一元管理

ある製造業の中小企業では、見積作成に熟練社員が1件あたり2時間かけていました。AIプラットフォームを導入し、過去の見積データを学習させたところ、見積作成時間が30分に短縮(75%削減)され、新人でも対応可能になりました。

重要なのは、AIが「人を置き換える」のではなく、**「人の能力を拡張する」**という視点です。

データ活用による意思決定の質向上

「なんとなく」「経験から」「勘で」——こうした判断は、小規模なビジネスでは有効でも、事業が拡大すると限界が来ます。

データドリブンな意思決定のメリット

- 感覚ではなく数値で判断できる

- リアルタイムでのデータ分析により、迅速な方針転換が可能

- 需要予測による在庫最適化、売上予測に基づく人員配置

ある小売店では、AIプラットフォームで過去3年分の販売データを分析し、雨の日は特定商品の売上が30%増加することを発見。天気予報と連動した仕入れ調整を実施した結果、廃棄ロス15%削減、売上機会損失20%減少を達成しました。

導入時によくある失敗パターンと対策

AIプラットフォームの導入で失敗する企業には、共通のパターンがあります。

失敗パターン1:目的が曖昧なまま導入

- 防ぐには:「何の課題を解決するのか」を明文化する

失敗パターン2:現場の声を聞かずに決定

- 防ぐには:導入前に現場担当者を巻き込み、試用してもらう

失敗パターン3:高機能すぎるツールを選択

- 防ぐには:「今必要な機能」を優先し、拡張性は二の次に

失敗パターン4:導入後のサポート不足

- 防ぐには:導入後3ヶ月は特に手厚くサポートする体制を作る

失敗パターン5:一度に全てを変えようとする

- 防ぐには:小さな範囲から始め、成功体験を積み重ねる

成功させるための準備と体制づくり

失敗パターンを避け、AIプラットフォーム導入を成功させるには、技術面よりも**「体制づくり」**が重要です。

導入前の準備チェックリスト

1. 目的と目標の明確化

- 解決したい課題を3つ以内に絞る

- 成功の基準を数値で定義する

- 達成期限を設定する

2. 推進体制の構築

- プロジェクトリーダーを決める

- 現場の推進担当者を決める

- 定例会議の日程を決める

3. 段階的な導入計画

- 第1フェーズ:最小限の機能で開始(1〜2ヶ月)

- 第2フェーズ:使い方に慣れたら機能追加(3〜4ヶ月)

- 第3フェーズ:全社展開と最適化(5〜6ヶ月)

成功する企業の共通点

- 経営者が率先して使う

- 小さな成功体験を積み重ねる

- 「使い続ける仕組み」を作る

- 外部の伴走支援を活用

統計的に、ITツールの定着率は導入後3ヶ月で決まると言われています。この期間に週1回の振り返りミーティング、クイックウィン(小さな成功)の創出、継続的な学習機会を設けることが成功の鍵です。

おすすめのAIプラットフォームと活用事例

ここからは、具体的なAIプラットフォームの製品を紹介します。「どれが一番良いか」ではなく、**「自社の課題と規模に合っているか」**という視点で選ぶことが重要です。

主要クラウドベンダーのAIプラットフォーム

Google Cloud AI Platform

- 特徴:画像認識、自然言語処理、予測分析など幅広い機能

- 向いている企業:データ分析に力を入れたい、技術者がいる企業

- 活用例:ECサイトでの商品レコメンデーション、顧客問い合わせの自動分類

Microsoft Azure AI

- 特徴:ExcelやPowerBIとの統合が容易

- 向いている企業:Office 365を活用している中小企業

- 活用例:営業データの分析と予測、ドキュメントの自動分類

Amazon Web Services (AWS) AI/ML

- 特徴:豊富なサービスラインナップと高い信頼性

- 向いている企業:将来的な事業拡大を見据えている企業

- 活用例:在庫需要予測、音声認識を使ったコールセンター支援

国内企業向けのAIプラットフォーム

NEC the WISE

- 特徴:日本語の自然言語処理に強い

- 向いている企業:製造業、流通業

- 活用例:需要予測、異常検知、業務自動化

Sony Neural Network Console

- 特徴:プログラミング不要でAIモデルを構築

- 向いている企業:AI技術者がいない、まずは試してみたい企業

- 価格帯:無料プランあり、有料プランは月額数千円〜

- 活用例:製品の不良品検出、需要予測、画像分類

業種別の活用事例

製造業

- 画像認識AIで製品の不良品を自動検出

- 過去の受注データから生産計画を最適化

- 設備の異常を事前に検知し、故障を防ぐ

小売業

- 売れ筋商品の予測で在庫ロスを削減

- 購買履歴から最適な商品提案

- 来店客数予測で人員配置を最適化

サービス業

- チャットボットで24時間対応

- 需要予測に基づく価格変動(ダイナミックプライシング)

- 定型業務の自動化で人手不足を解消

中小企業での導入成功事例

事例1:食品製造業(従業員50名)

課題:熟練社員の退職で品質管理のノウハウが失われる危機

導入内容:画像認識AIを活用した品質検査システム

成果

- 検査時間を60%削減

- 不良品の検出精度が向上(見逃し率50%減少)

- 新人でも一定レベルの品質管理が可能に

事例2:卸売業(従業員30名)

課題:在庫管理がExcel頼りで、欠品や過剰在庫が頻発

導入内容:クラウド型の需要予測・在庫管理システム

成果

- 在庫回転率が25%改善

- 欠品による機会損失を年間300万円削減

- 担当者の業務時間が週10時間削減

事例3:サービス業(従業員20名)

課題:電話での問い合わせ対応に追われ、本来業務に集中できない

導入内容:チャットボット+FAQ自動生成システム

成果

- 問い合わせ対応時間が40%削減

- 24時間対応が可能になり、顧客満足度向上

- スタッフがコア業務に集中できるように

共通する成功要因

- 明確な課題設定

- 小さく始める

- データの準備

- 伴走支援

- 経営層のコミット

既製品が合わないときの選択肢

ここまで様々なAIプラットフォームを紹介してきましたが、「どれも自社には合わない」「もっと自社の業務に特化したものが欲しい」と感じた方もいるかもしれません。

自社に合わせた仕組みづくり

既製品のAIプラットフォームが合わない理由は様々です。

よくある「合わない」理由

- 自社の業務フローに合わせるには、カスタマイズ費用が高額になる

- 必要な機能がないのに、不要な機能が多くて複雑

- 業界特有の用語や計算方法に対応していない

- 既存システムとの連携が難しい

こうした場合、自社専用のシステムを開発するという選択肢があります。

従来、自社専用システムの開発には「数百万円〜数千万円」「半年〜1年以上」というイメージがありました。しかし、AI技術の進化により、開発のハードルは大きく下がっています。

- 開発期間:数ヶ月 → 数週間〜2ヶ月

- 開発費用:数百万円 → 数十万円〜

- 保守運用:専任担当が必要 → クラウドで自動化

「ちょうどいい」規模のシステムを、「ちょうどいい」コストで作れる時代になっています。

業務フローの整理から始める重要性

AIプラットフォームやシステムを導入する前に、最も重要なのが**「業務フローの整理」**です。

システムは「業務を効率化する道具」であって、「業務の問題を解決する魔法」ではありません。混乱した業務をそのままシステム化しても、混乱がデジタル化されるだけです。

業務整理の進め方

- 誰が、いつ、何を、どのように行っているかを書き出す

- 業務フロー図を作成する

- 無駄な作業、重複している作業を見つける

- 理想の業務フローを設計する

この業務整理のプロセスを経ることで、本当に必要な機能が明確になり、システム導入の効果も最大化されます。

伴走型の支援を受けるメリット

AIプラットフォームの導入や自社システムの構築において、外部の専門家による伴走支援を受けることは、成功確率を大きく高めます。

伴走支援で得られるもの

- 業務フローの整理から一緒に考えてくれる

- 自社に本当に必要な機能を見極められる

- 導入後の定着まで継続的にサポートしてくれる

- 困ったときにすぐ相談できる安心感

特に中小企業では、社内にIT専門の人材がいないことが多いため、導入後の運用フェーズでつまずくケースが多く見られます。伴走型の支援があれば、こうしたリスクを大幅に減らせます。

まとめ:AIプラットフォームで実現する「ちょうどいい」デジタル化

AIプラットフォームは、中小企業にとって「大きすぎず、小さすぎない、ちょうどいいデジタル化の選択肢」です。

重要なポイントのおさらい

- AIプラットフォームとは、AI開発や運用に必要な機能がまとまった基盤

- 従来のシステム開発に比べ、短期間・低コストで導入可能

- 業務特化型、クラウド型、エンタープライズ型など、様々な選択肢がある

- 自社の課題を明確にし、「ちょうどいい」ものを選ぶことが成功の鍵

- 導入後3ヶ月の定着支援が成否を分ける

- 既製品が合わない場合は、自社専用システムの開発も現実的な選択肢

AIプラットフォームの導入は、単なるツールの導入ではありません。業務のあり方を見直し、データを活用した経営判断を実現し、属人化を解消する——そうした企業変革のきっかけです。

「完璧に使いこなす」ことよりも、「毎日少しずつ使う」習慣を作ることが成功の鍵です。小さく始めて、成功体験を積み重ね、段階的に活用範囲を広げていきましょう。

もし、AIプラットフォーム選びや導入に不安がある場合は、業務フローの整理から伴走してくれる専門家のサポートを受けることをおすすめします。自社に本当に必要な機能を見極め、導入後の定着まで支援してくれるパートナーがいれば、デジタル化の成功確率は大きく高まります。